Alibaba Group обновила семейство языковых моделей Qwen 2.5

Разработчики китайской компании Alibaba Group представили обновление семейства языковых моделей Qwen 2.5. Обновили базовую нейросеть и модели, дообученные для решения математических задач и работы с кодом.

Qwen 2.5

Qwen версии 2.5 выпустили в шести размерах: 0.5B, 1.5B, 3B, 7B, 14B, 32B и 72B. Если раньше разработчики уделяли внимание только компактным и большим моделям, но в этот раз опубликовали нейросети среднего размера — 14 и 32 млрд параметров. Для обучения Qwen 2.5 обучали на увеличенном датасете, включающем в себя 18 трлн токенов. Отмечается, что нейросеть лучше справляется со сложными задачами, понимает структурированные данные и может генерировать ответы в JSON.

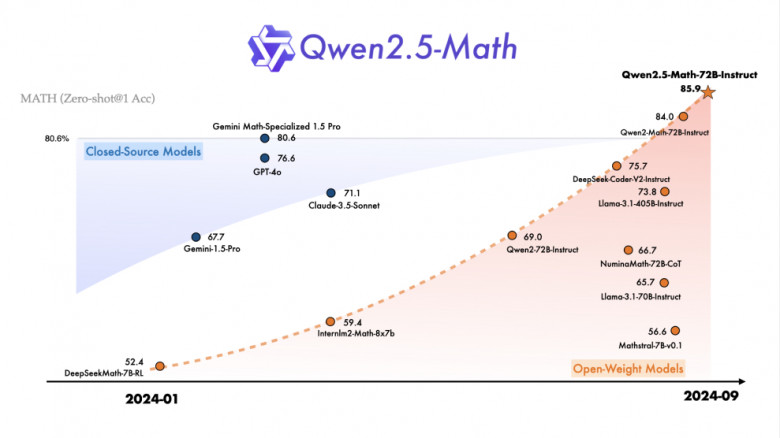

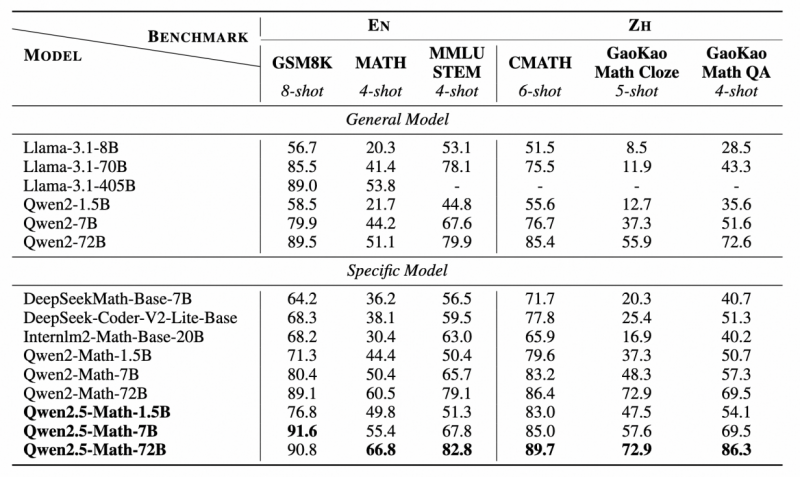

Qwen 2.5 Math

Базовая языковая модель, специально дообученная для решения математических задач. Для обучения использовали данные из набора Qwen Math Corpus v2, которые включает в себя 1 трлн токенов. Вместе с ней доступна нейросеть Qwen2.5-Math-Instruct.

Qwen2.5 Coder

Модель, которую дообучили для генерации кода. Доступа всего в трёх размерах: 1,5B, 7B и 32B. Для обучения использовали набор данных из 5,5 трлн токенов. Из нововведений отмечают лучшее понимание задач, связанных с кодом и расширенный датасет. Нейросеть знает 92 языка программирования и может обрабатывать контекст до 128 токенов. Модель подходит для генерации кода, проверки, исправления и автоматического дополнения.

Более детально о моделях можно узнать на официальном сайте проекта. Сами модели доступны на GitHub и Hugging Face (1, 2).